Come individuare falsi filmati di guerra dopo gli attacchi statunitensi contro i siti nucleari iraniani

I manifestanti portano cartelli e sventolano una bandiera iraniana mentre si radunano fuori dalla Casa Bianca domenica 22 giugno 2025 a Washington per protestare contro l'attacco militare statunitense su tre siti in Iran all'inizio di domenica. (AP Photo/Jose Luis Magana)

I manifestanti portano cartelli e sventolano una bandiera iraniana mentre si radunano fuori dalla Casa Bianca domenica 22 giugno 2025 a Washington per protestare contro l'attacco militare statunitense su tre siti in Iran all'inizio di domenica. (AP Photo/Jose Luis Magana)Immagini e video di esplosioni, proteste e armi sono diventati virali dopo gli attacchi del 21 giugno degli Stati Uniti a tre siti nucleari iraniani, ma molti di loro non mostravano cosa stesse realmente accadendo.

Sono stati invece generati dall’intelligenza artificiale decontestualizzata o registrata da videogiochi o simulatori di volo. Molti di essi erano condivisi da X account con segni di spunta blu precedentemente associati ad account appartenenti a persone o organizzazioni con identità verificate. (Ora possono essere acquistati.)

Può essere difficile sapere a prima vista sulle piattaforme di social media se le didascalie allarmanti si adattano effettivamente alla foto o al video che vedi; a volte i programmi di note della comunità aggiungono contesto ma a volte no .

PolitiFact ha verificato alcuni dei video e delle immagini fuorvianti sull'attacco statunitense e sulla reazione ad esso. Ecco una guida su cosa evitare e suggerimenti su come verificare le immagini in conflitto.

Le immagini generate dall'intelligenza artificiale spesso contengono incoerenze visive

Un account con spunta blu su X chiamato Ukraine Front Line ha pubblicato un video 22 giugno che mostra un fulmine che colpisce un pennacchio di fumo che erutta in una foschia infuocata. La didascalia avvisava della guerra nucleare: per favore presta attenzione al fulmine! Questo è il segno più sicuro che l’esplosione è stata effettivamente nucleare.

Ma il video non mostra un evento reale. È stato caricato 18 giugno su YouTube con la didascalia ai video. IL biografia dell'account legge Tutti i video su questo canale sono prodotti con intelligenza artificiale.

Alcuni modelli di intelligenza artificiale generativa consentono alle persone di scrivere suggerimenti per generare video realistici e i risultati stanno diventando sempre più sofisticati.

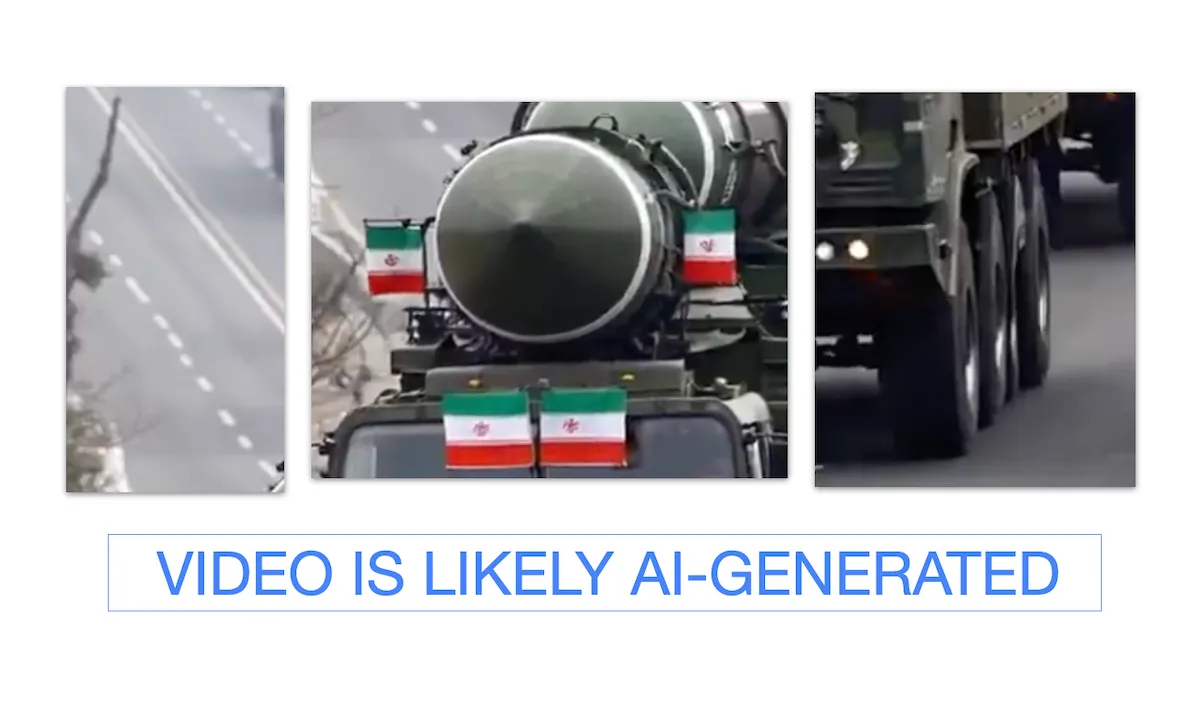

Ma non sono perfetti e guardando attentamente i video rivelerai spesso incongruenze visive. Un video La didascalia Prepararsi per lo sciopero (di stasera) mostrava camion con bandiere iraniane che trasportavano missili. Uno sguardo più attento ha mostrato che le linee sulla strada erano irregolari, un pneumatico del secondo camion sembrava avere un pezzo strappato e anche i caratteri sulle bandiere non corrispondevano alla vera bandiera iraniana.

(Schermate/X)

chelsy bakula

Hany Farid, professore della UC Berkeley specializzato in informatica forense ha scritto su LinkedIn che molti video generati dall'intelligenza artificiale spesso durano otto secondi o meno o sono composti da clip di otto secondi montati insieme. Questo è perché Google ne vedo 3 un modello da testo a video ha un limite di otto secondi. Alcuni video hanno filigrane visibili ma gli utenti possono ritagliarle.

I media travisati lo sono stati storicamente più prominente rispetto alle immagini dell'intelligenza artificiale durante le ultime notizie. Ma durante questa guerra sia gli account pro-Israele che quelli pro-Iran hanno condiviso le immagini dell’intelligenza artificiale. Lo ha detto Emmanuelle Saliba, capo investigativa della società di analisi forense digitale Get Real Labs Verifica della BBC è stata la prima volta che abbiamo visto l’intelligenza artificiale generativa utilizzata su larga scala durante un conflitto.

I disinformatori continuano a condividere vecchie immagini e video fuori contesto

Oltre al crescente utilizzo dell’intelligenza artificiale da parte dei disinformatori, non sono mancate immagini e video condivisi con il contesto sbagliato.

Proteste di massa scoppiano in tutta l’America mentre i cittadini scendono in strada indignati dopo che gli Stati Uniti hanno lanciato un attacco contro l’Iran sottotitolato 22 giugno X post Leggere. Ma il video è stato caricato 14 giugno il giorno delle proteste No Kings in tutto il Paese.

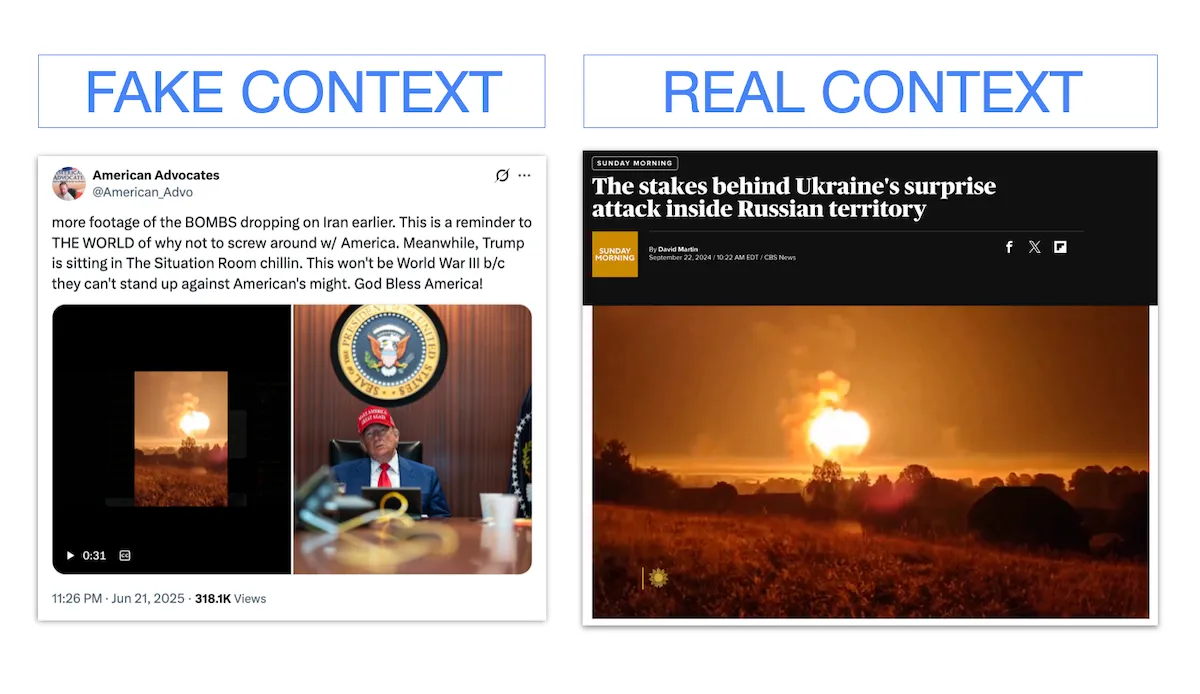

Un altro video di X condiviso la notte degli attacchi statunitensi mostrava un grande pennacchio di fuoco e fumo. Altri filmati delle BOMBE sganciate sull'Iran si leggevano in precedenza didascalia video . Ma questo è falso; il video proveniva da un 2024 Attacco ucraino alla Russia .

(Screenshot/X CBS News)

Una ricerca inversa delle immagini può rivelare se un video è stato pubblicato online in precedenza e quale era il contesto originale. Strumenti come Google Lens e TinEye possono mostrare dove le immagini o i video sono stati condivisi tra le piattaforme che li hanno pubblicati e quando è stato pubblicato il primo post. Le didascalie delle immagini pubblicate dai notiziari mostreranno probabilmente quando e dove sono state scattate.

vince neil coniuge

I filmati dei videogiochi provengono dai playbook dei conflitti precedenti

Anche le immagini registrate dai simulatori di volo e dai videogiochi militari travisano il conflitto.

Questo è il bombardiere stealth B2 Spirit in decollo in California! leggi un 21 giugno X post da un conto corrente blu prima dell’attacco all’Iran.

Solo che non era un vero bombardiere B2. Il controllo della filigrana del video porta a un account TikTok che ha pubblicato il video 15 maggio con l'hashtag #microsoftflightsimulator un gioco di simulazione disponibile su Xbox.

Anche il gameplay del videogioco Arma lo è suscettibili di uso improprio durante i conflitti armati . Affermazioni verificate da PolitiFact che utilizzavano filmati di Arma durante il Guerra Ucraina-Russia e il Guerra Israele-Hamas .

Le ricerche di parole chiave su piattaforme video come YouTube possono mostrare se i video corrispondono a filmati di videogiochi caricati in precedenza.

Modi semplici per analizzare l'affidabilità dei conti

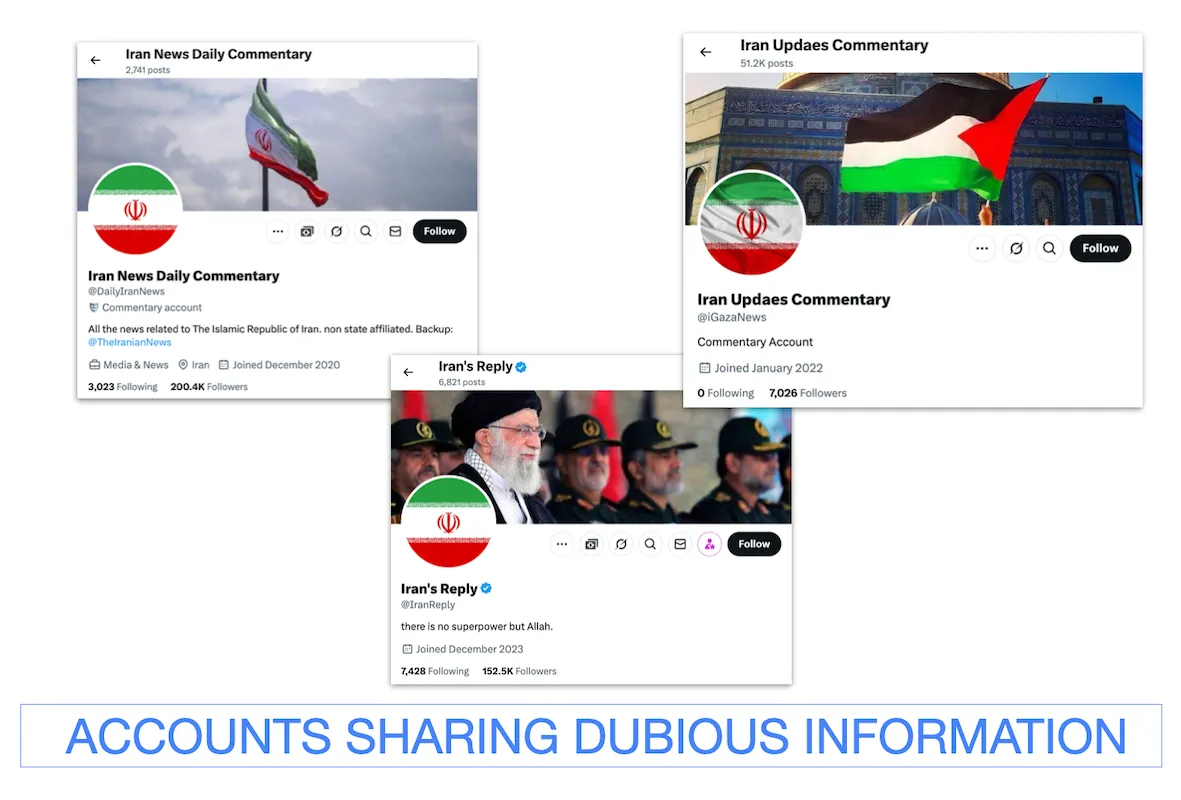

Controllare il profilo e la biografia di un account rivelerà spesso se è credibile o meno. Molte affermazioni false e fuorvianti provengono da account con la bandiera iraniana come foto del profilo e nomi visualizzati che possono essere confusi con la fornitura di aggiornamenti di notizie legittimi.

Tali account includono Iran Updaes Commentary (errore di battitura incluso) e Iran News Daily Commentary. Un altro account – con una spunta blu – si chiama Iran’s Reply.

(Schermate/X)

Ma questi non sono affiliati al governo iraniano o ad alcuna fonte credibile. PolitiFact lo ha scoperto post su questi conti guadagno centinaia di migliaia se non milioni di visualizzazioni ma contengono contenuti di bassa qualità come immagini generate dall'intelligenza artificiale. Questo controllo dei fatti era originariamente pubblicato da PolitiFact che fa parte del Poynter Institute. Vedi le fonti per questo fact check Qui .