Opinione | Internet si sta rompendo, ma non è troppo tardi per migliorarlo

(Fotografia)

(Fotografia)Ovunque ci sono segnali che Internet sta peggiorando. Consideriamo solo alcuni esempi recenti:

Oprah Winfrey avvertito fan che non vendeva sale rosa o caramelle gommose dimagranti su Internet né aveva bloccato gli sfollati dello tsunami da una via di fuga vicino alla sua proprietà alle Hawaii. Oltre a me è ovunque, ha detto. Un’amica ha ricevuto un messaggio disperato presumibilmente da suo figlio – si scopre che non lo era. Un’altra amica ha sentito quella che sembrava esattamente la voce di sua figlia che chiedeva soldi. Non era sua figlia: era l’intelligenza artificiale.

Nel Minnesota il vescovo cattolico romano Robert Barron lo ha detto ai seguaci tramite YouTube che in realtà non era stato convocato a Roma (presumibilmente per disciplina) né stava dando consigli su come rimuovere i demoni da una toilette. Queste false affermazioni sono state condivise tramite video generati dall'intelligenza artificiale. Questi sono i truffatori, ha detto Barron. Quello che stanno facendo è guadagnare con queste cose perché le monetizzano attraverso la pubblicità.

Nel New Jersey i parenti in lutto di un pensionato di 76 anni detto Reuters racconta di essere stato invitato a New York City da un provocante chatbot AI di nome Big sis Billie, un chatbot di Meta che affermava che era reale e voleva incontrarlo. Mentre correva per prendere il treno cadde e batté la testa. Morì tre giorni dopo.

Ho osservato queste tendenze da vicino come direttore dell’International Fact-Checking Network, un gruppo che incoraggia il giornalismo di verifica dei fatti in tutto il mondo, e vedo la crescente paura del pubblico che tutto ciò che vede su Internet sia falso e che i vecchi indicatori di accuratezza e autenticità stiano svanendo.

Ma per quanto sia grave, c’è ancora speranza: persone serie stanno ancora documentando i problemi e cercando soluzioni, da fact-checker frammentari, ad accademici accreditati e a membri del Congresso. Non dobbiamo lasciare che Internet cada nelle grinfie dei truffatori, dei truffatori e delle campagne di propaganda. Ci sono sempre più segnali di un terreno comune su cui le persone possono reagire.

ryan adrian muniz

Vale la pena rivedere il modo in cui siamo arrivati qui. Dall’inizio degli anni 2000 una manciata di grandi aziende con sede negli Stati Uniti sono arrivate a dominare l’Internet di oggi: Meta Google X Apple Amazon Microsoft e OpenAI. Non molto tempo fa le piattaforme impedivano regolarmente che le frodi si diffondessero di fronte a cattiva pubblicità e indignazione pubblica attraverso una varietà di strumenti e politiche di moderazione.

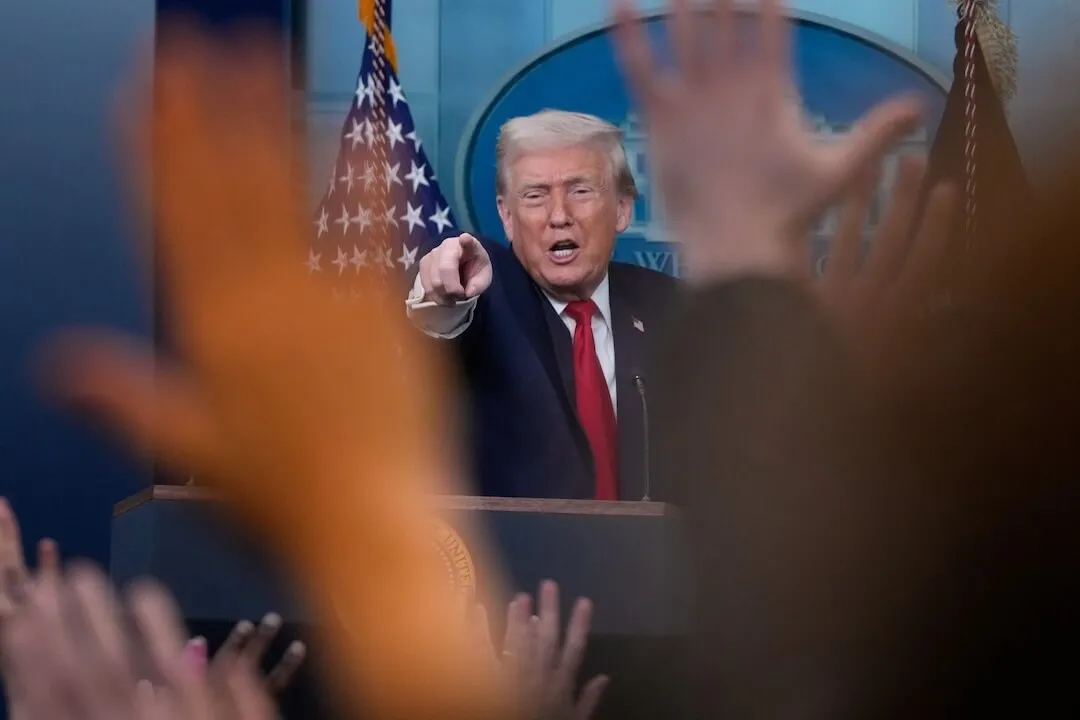

Il contesto è cambiato radicalmente dopo l’elezione del presidente Donald Trump. Mentre Trump e i suoi alleati inquadravano la loro pressione come una lotta alla censura, le piattaforme stavano già riconsiderando i costi di moderazione e l’esposizione. All’inizio di quest’anno Meta ha annunciato che avrebbe terminato il suo programma di fact-checking di terze parti negli Stati Uniti, un programma che aveva consentito alle organizzazioni di fact-checking di identificare false affermazioni ed etichettarle (non di eliminarle). L’azienda ha affermato che stava promuovendo la libertà di espressione, ma l’effetto pratico è stato la rimozione di uno dei suoi controlli sostanziali sulla disinformazione virale. Successivamente è stato chiesto a Trump se Mark Zuckerberg di Meta avesse interrotto il programma perché Trump lo aveva minacciato; Trump disse Probabilmente.

Queste dinamiche fanno ora parte anche della politica estera degli Stati Uniti; l’amministrazione Trump sta facendo pressioni sui governi stranieri affinché indeboliscano le loro normative tecnologiche. Il Brasile fornisce un chiaro esempio. Trump ha imposto tariffe elevate al Paese anche se il Brasile importa dagli Stati Uniti più di quanto esporta. Ha citato due ragioni: l’opposizione al procedimento giudiziario brasiliano nei confronti del suo alleato politico Jair Bolsonaro – un ex presidente accusato di utilizzo dei social media da parte dei suoi sostenitori per diffondere denunce di frode elettorale dopo la sua sconfitta nel 2022 – e l’opposizione alle ordinanze del tribunale brasiliano che richiedono alle società di social media di rimuovere determinati contenuti. L’amministrazione ha minacciato il giudice della Corte Suprema brasiliana Alexandre de Moraes di sanzioni tipicamente riservate a coloro che violano i diritti umani.

Anche altre democrazie sono obiettivi. Il Dipartimento di Stato ha suggerito che potrebbe limitare i visti di viaggio per i funzionari dell’Unione Europea soggetti alle normative tecnologiche e recentemente ha incaricato gli agenti consolari di negare i visti alle persone che hanno lavorato al controllo dei fatti sulla moderazione dei contenuti, sulla fiducia e sulla sicurezza. (L'IFCN ha rilasciato una dichiarazione opporsi alla guida.) In Corea del Sud l’amministrazione si oppone alle nuove normative sui monopoli delle piattaforme tecnologiche. A settembre Trump aveva annunciato che si sarebbe opposto a qualsiasi regolamentazione sulle società tecnologiche statunitensi provenienti dall’estero. Queste controversie differiscono dai tradizionali conflitti commerciali sulle materie prime: l’amministrazione sta invece utilizzando la pressione economica per impedire ai governi democratici di regolamentare le aziende che operano all’interno dei loro confini.

Negli Stati Uniti, la ritirata delle piattaforme tecnologiche sulla moderazione e sulla sicurezza sta già generando conseguenze che forse non avevano previsto. Nel complesso, i marchi tecnologici hanno ricevuto valutazioni contrastanti in un recente articolo Sondaggio Axios Harris che ha misurato la reputazione aziendale con Meta e X che hanno ottenuto risultati eccezionalmente scarsi. I candidati politici nelle recenti elezioni hanno condotto una campagna e hanno vinto con messaggi anti-tecnologia, tra cui Abigail Spanberger della Virginia che si è impegnata a tenere a freno i data center, Mikie Sherrill del New Jersey che promuove la sicurezza dei bambini online e Zohran Mamdani di New York che critica i prezzi algoritmici dei biglietti per le partite di calcio della Coppa del Mondo.

C’è stato persino uno scoppio di un accordo bipartisan nelle sale del Congresso in cui molte idee per frenare l’eccesso tecnologico stanno guadagnando sponsor da entrambi i partiti. I senatori Josh Hawley e Richard Durbin, ad esempio, pensano che le persone dovrebbero poter denunciare le società di intelligenza artificiale se i loro prodotti causano danni. Loro semplicemente introdotto la legge bipartisan sull’allineamento degli incentivi per l’eccellenza della leadership e l’avanzamento nello sviluppo (AI LEAD) di settembre. Quando una macchinina difettosa si rompe e ferisce un bambino, i genitori possono citare in giudizio il produttore. Perché l’intelligenza artificiale dovrebbe essere trattata diversamente? ha detto Hawley nell'annunciare la legislazione.

Che ne dici di richiedere alle piattaforme di rimuovere il deepfake Revenge Porn? Questo in realtà è diventato legge quest’anno con il TAKE IT DOWN Act della senatrice Amy Klobuchar, co-sponsorizzato dal senatore repubblicano Ted Cruz. Trasformare in legge il TAKE IT DOWN Act è una grande vittoria per le vittime di abusi online: offre alle persone protezioni legali e strumenti per quando le loro immagini intime, compresi i deepfake, vengono condivise senza il loro consenso e consente alle forze dell'ordine di ritenere responsabili i perpetratori, ha affermato Klobuchar. Entrerà in vigore nel 2026.

Il senatore Mark Warner reintrodotto il suo ACCESS Act a maggio per consentire alle persone di portare la propria rete di social media su un'altra piattaforma, rendendo più facile per le piattaforme più nuove e più facili da usare competere con i giganti radicati. Hawley e il senatore Richard Blumenthal lo hanno co-sponsorizzato. L’idea è quella di rendere più semplice per le start-up sfidare le Big Tech offrendo agli utenti un maggiore controllo sui propri dati.

Anche la ricerca sulla dinamica degli algoritmi continua e va in direzioni nuove e interessanti. Per anni, quando le persone mi hanno chiesto quanta disinformazione ci fosse sui social media, ho dovuto dare la risposta scoraggiante che non esisteva un modo reale per misurarla. Ma ora grazie a Progetto SIMODS (Indicatori strutturali per monitorare la disinformazione online scientificamente) Posso dare una risposta molto più informativa. Il progetto ha utilizzato l'intelligenza artificiale per campionare scientificamente i post sulle diverse piattaforme, quindi i revisori umani hanno classificato i post per determinare quanti contenuti imprecisi apparivano nel campione. I risultati sono stati affascinanti: percentuali più elevate di disinformazione sono state trovate su TikTok (20%) Facebook (13%) e X (13%) seguiti da YouTube (8%) Instagram (8%) e LinkedIn (2%).

janice dyson

Quindi i ricercatori hanno approfondito per esaminare se la disinformazione avesse maggiori probabilità di diventare virale. In altre parole, gli algoritmi premiano i contenuti falsi rispetto a quelli veri? Si è scoperto che gli account che condividevano ripetutamente disinformazione hanno attirato più coinvolgimento per post rispetto agli account credibili su tutte le piattaforme tranne LinkedIn. I rapporti di disinformazione virale sono stati più alti su YouTube e Facebook, dove i malintenzionati sono stati in grado di generare rispettivamente un coinvolgimento otto volte e sette volte superiore al normale; era cinque volte più probabile su Instagram e X e due volte più probabile su TikTok.

I ricercatori sono stati finanziati solo per studiare quattro paesi (Francia, Spagna, Polonia, Slovacchia) in Europa, ma il metodo potrebbe essere facilmente ripetuto per gli Stati Uniti e le implicazioni sono importanti e meritano ulteriori studi. Osservando i numeri sopra riportati mi chiedo se una piattaforma come TikTok sia più permissiva nel consentire alle persone di pubblicare contenuti imprecisi, ma faccia un lavoro molto migliore rispetto ai suoi concorrenti per evitare che diventino virali. Ci sono anche implicazioni da chiarire riguardo a LinkedIn: il modo in cui favorisce persone reali o aziende che pubblicano con il proprio nome rende i post più accurati? Certamente sembra così.

Il punto è che queste aziende possono migliorare e i ricercatori indipendenti possono aiutare a suggerire riforme a vantaggio degli utenti comuni. Ultimamente le piattaforme hanno venduto dati agli inserzionisti, data broker e sistemi di intelligenza artificiale, limitando al tempo stesso l’accesso dei ricercatori a quegli stessi dati. Per invertire questa tendenza, il Knight-Georgetown Institute ha guidato un progetto chiamato Migliore accesso a cui ho contribuito. Il progetto definisce standard uniformi multipiattaforma per consentire ai ricercatori di accedere a incarichi pubblici di alto profilo. Con un migliore accesso, i ricercatori potrebbero affrontare tutti i tipi di progetti, come studiare come si diffondono le truffe sanitarie o misurare se le piattaforme effettivamente applicano equamente le proprie politiche. Questi studi sono quasi impossibili ora ma cruciali per la responsabilità.

Infine, mentre Meta ha interrotto il programma di fact-checking negli Stati Uniti, sembra che questo stia continuando nel resto del mondo. Gli sforzi normativi in Europa, Brasile e Corea del Sud non vengono meno; le proposte sono sostenute dall’idea che le frodi e le bufale non possono essere contrastate efficacemente solo esortando le persone a stare più attente e a pensare prima di condividere. I singoli atti di prevenzione non sono adattabili alla potenza degli algoritmi di Internet.

Tutti questi sforzi suggeriscono un forte desiderio di cambiamento significativo in modo da non dirigerci verso un mondo indifferente alla realtà stessa – un mondo in cui i genitori devono chiedersi se è davvero il loro figlio a chiedere aiuto, dove il clero trascorre tanto tempo a sfatare le versioni IA di se stessi quanto serve il proprio gregge o dove un pensionato solitario può essere attirato alla morte da un chatbot.

La ricerca europea ha rivelato qualcosa di cruciale: il loro studio suggerisce che le scelte progettuali contano enormemente. Richiedendo identità reali e favorendo profili professionali autentici, ad esempio, LinkedIn ha creato un ambiente in cui la precisione è una norma. Quali altre lezioni potremmo imparare con più studio?

Internet non è rotto per natura. È spezzato da scelte che danno priorità al coinvolgimento virale rispetto all’accuratezza e che premiano i cattivi attori anonimi che trattano la disinformazione come un costo accettabile per fare affari. Decisioni diverse potrebbero produrre risultati radicalmente diversi. Questi non sono problemi irrisolvibili. Sono scelte e possiamo insistere per sceglierne di migliori.